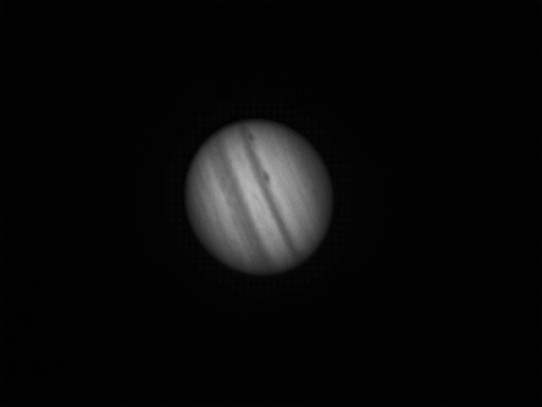

Giove – 20/08/2009

Briosco (MB), 20/08/2009 – Giove

1000 frames per fotogramma, webcam Philiphs SPC 900 NC + Achromatic Barlow 3x + IR cut filter. Telescopio Newton SkyWatcher 150 mm f/5 EQ3-2. Elaborazione Registax 5.0 + StarTrails. (scarica il video in formato AVI o i singoli fotogrammi in formato ZIP)